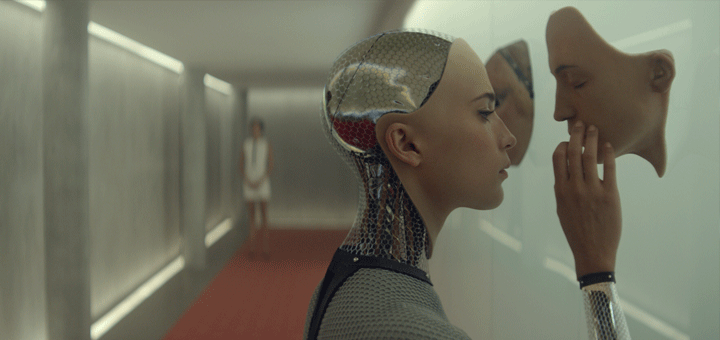

Po niedawnym seansie filmu Ex Machina, zaczęliśmy się z Aleksandrą zastanawiać, czy chcielibyśmy żyć w świecie, w którym Sztuczna Inteligencja zaczęłaby budzić się do życia. Tak, życia.

Czy sztucznie stworzony obiekt, któremu nadano ludzkie cechy, własną świadomość, środowisko do nauki nowych bodźców, emocjonalne zaplecze oraz możliwość podejmowania decyzji w czasie rzeczywistym na podstawie własnych doświadczeń można nazwać cząstką człowieczeństwa?

Analitycy obawiają się, że spuszczona z wodzy, Sztuczna Inteligencja [w skrócie SI lub AI], może wykształcić w sobie psychotyczne zachowania, które w połączeniu z wolą przetrwania, reprodukcji i ciągłego samodoskonalenia wykluczy z łańcucha ludzki gen, tym samym dążąc do usunięcia pasożyta z powierzchni planety. Zagłada może się wydarzyć z dwóch powodów – różnic poglądowych odnośnie rozwoju samej technologii, gdzie AI bojąc się o swój byt zacznie się bronić, korzystając ze wszystkich dostępnych środków – muszę przypominać, za co odpowiadają dziś systemy informatyczne?

Drugi scenariusz wlicza w równanie ekstremistów, którzy będą obawiać się dominacji maszyn i rozpoczną otwartą wojnę z maszynami. Terminator anyone? Moim skromnym zdaniem, informacja o wynalezieniu w pełni samodzielnej Sztucznej Inteligencji rozpoczęłoby falę samobójstw na całym świecie, rozpoczynając jednocześnie niezwykle interesujące, ale delikatne lata na kartach historii. Znając naturę człowieka oraz zero-jedynkowość maszyn – do bezpośredniej konfrontacji doszłoby raczej prędzej niż później.

Problem może leżeć w nieodpowiednim przygotowaniu – ludzie będą za wszelką cenę dążyć do jak najszybszego rozwoju technologii, jednak ta zacznie ich przerastać i może zwrócić się przeciwko nim. Nie da się ukryć, że możliwości rozwoju samoświadomego organizmu, za którym stać będą mikroprocesory, sieci społecznościowe, nieskończone pokłady mocy w chmurze oraz zasoby Internetu znacznie przekraczają możliwości przerobowe szaraczka Kowalskiego, więc może dojść do sytuacji rodem z filmu Her, do którego zobaczenia serdecznie zachęcam.

To właśnie Her oraz Ex Machina wywarły na mnie największe wrażenie jeśli chodzi o temat Sztucznej Inteligencji, samoświadomości oraz tego, co może się stać, jeśli odpowiednio nie przygotujemy się na to, co niesie ze sobą odkrycie sposobu na stworzenie wyżej opisywanej, sztucznej świadomości. W zeszłym roku temat ten podjął również film Transcendence, który pomimo klapy finansowej, również dał do myślenia i tylko dzięki temu nie trafił u mnie do kategorii gniotów. Wspominałem już, że uwielbiam filmy, których zamysł jest dobrym punktem wyjścia do ciężkich rozmyślań przez następnych kilka dni lub nawet tygodni?

Kolejną produkcją, która jeszcze wcześniej, jednak na nieco mniejszą skalę, pokazała czym grozi wypuszczenie na wolność SI to Eagle Eye. Tam komputer przejął kontrolę nad m.in. siecią wojskową, energetyczną oraz komunikacyjną i w ten sposób manipulował życiem dwójki głównych bohaterów. Łącząc w sobie cząstkę każdego z tych filmów, wyłania się mocno destruktywny obraz bezdusznej maszyny, która tylko czeka na wpuszczenie w sieć i rozpoczęcie mordu – tutaj pojawiają się głosy, by zmusić AI do bycia miłym, wgrać kilka dyrektyw, według których odbywała się komunikacja na linii maszyna-człowiek i sztucznie ograniczyć możliwości takich tworów – ale czy to nie mijałoby się z zamysłem samoświadomej maszyny, której nie odmawiano by prawa do nauki oraz doświadczania?

Oczywiście zaraz podniosą się głosy, że ludzie również żyją według zasad i reguł, które odgórnie im narzucono [vide prawo, kodeksy i religia], ale ma to związek z niedoskonałą naturą człowieka. Czy w przypadku, kiedy maszyna kalkulująca ryzyko w czasie rzeczywistym i dążąca do minimalizacji niepotrzebnych interakcji, byłaby nastawiona na niepopełnianie błędów – takie zasady miałyby w ogóle zastosowanie? Nikt nie bierze pod tego, że samoświadoma maszyna, mogłaby być zdolna do rzeczy tak ludzkiej jak popełnienie błędu. Ponownie wracamy do założeń Sztucznej Inteligencji i do postawienia sobie pytania, czy owa Inteligencja ma przypominać człowieka, imitować jego zachowanie, być osobnym bytem lub też współistnieć we wspólnym, technologicznie zaawansowanym społeczeństwie i być traktowana na równi z ograniczonym możliwościami własnego organizmu człowiekiem.

Zasadniczy problem z AI nie tyczy samej Sztucznej Inteligencji, a strachu przed tą technologią. Strachu ludzi, którzy chyba nie do końca wiedzą jak z nią obcować, jak się do niej ustosunkować i którzy boją się, że przejmie ona kontrolę nad światem. Strach przed nieznanym? Uprzedzenia w stosunku do czegoś, z czym nie miało się kontaktu? Obawa wyobcowania i zepchnięcia na dalszy plan przez napływ nowych przedstawicieli społeczeństwa? Czy nie brzmi to jak ksenofobia, którą tak usilnie staramy się wyplewić z naszego codziennego życia? Idźmy dalej, problem będzie można podpiąć pod rasizm czy nietolerancję dla ludzi o innej orientacji seksualnej. Obawa przed ryzykiem, którego wcale nie musi być, może być samospełniającym się proroctwem. Swego czasu Henry Ford, widząc obawy ludzi przed automobilami, nazwał ten typ strachu „terrorem maszyny” i termin ten ma również zastosowanie w tym przypadku.

Wszelkie porównania wydajnościowe scenariusza w którym Sztuczna Inteligencja jest wśród nas, nie pozostawiają złudzeń – w świecie AI, człowiek byłby zaledwie koegzystorem, a nie dyrektorem tego cyrku. Pojawiłoby się kolejne pytanie – czy człowiek byłby w stanie zaufać maszynie? Czy ta „lubiłaby” go ze względu na korzyści jakie z tego płyną, a może z czystej życzliwości? Koncept zaufania, miłości, przyjaźni i interakcji na poziomie mikro-interakcji wydaje się być niemożliwym do podrobienia przez maszynę, jednak tak naprawdę jest to zespół procedur, mikroekspresji, zachowań i zwyczajów, które na bazie obserwacji można wyjaśnić, opisać oraz wdrożyć za pomocą linijek kodu, instrukcji lub zbiorów algorytmów. Przerażająca wizja, do której nieuchronnie dążymy – Siri lub bohaterka filmu Her świetnie pokazują, że ludzie pragną interakcji ze swoimi urządzeniami, które ułatwiają im życie na co dzień. Co gdyby zamiast telefonu lub systemu operacyjnego, kupowalibyśmy sobie przyjaciela? Czy wtedy byłby to nasz osobisty asystent, a może już niewolnik? Czy jeśli AI wykonywałoby dla człowieka pracę, to czy musiałaby być ona opłacana jak człowiek?

Załóżmy sytuację, w której celem AI jest rozwój i ekspansja, co wiąże się z pozyskiwaniem surowców. Gdzieś, kiedyś, człowiek stanie na drodze maszynie – nie dlatego, że ta chce nas zgładzić, ale dlatego, że po prostu stoimy na drodze ku spełnieniu założeń oprogramowania. Sytuację taką teoretycy nazywają „uboczną eksterminacją”, która nie wynika z nienawiści, ale z konfliktu celów. A to tylko jeden ze scenariuszy, gdzie człowiek może zareagować agresywnie w stosunku do maszyny, która zacznie się (słusznie) bronić. A co z rozwojem technologii? Powiedzmy, że rozwinie się nanotechnologia – w stopniu, w którym człowiek przestanie pojmować jej zastosowanie i wpływ jaki może ona wywrzeć na ich życie – zrodzi to, ponownie, strach o którym wspominał Henry Ford.

Stephen Hawking wespół z innymi teoretykami doszedł do wniosku, że wynalezienie Sztucznej Inteligencji „byłoby największym błędem w historii ludzkości”, bo rodziłoby to wątpliwości natury etnicznej, egzystencjalnej i przede wszystkim moralnej. Człowiek urósłby do rangi Boga, który tworzy sztuczną świadomość na swoje podobieństwo, ale to również może okazać się obusiecznym mieczem. Hawking ponownie ostrzega: „Stworzenie Sztucznej Inteligencji może być największym przełomem w historii ludzkości. Może też być naszym ostatnim, chyba, że nauczymy się jak uniknąć ryzyka”. Tym ryzykiem może być rozbieżność finansowa ludzi i cyborgów, śmiertelność tych pierwszych i teoretyczna nieśmiertelność drugich, masowa świadomość korzystając z zasobów chmury, czego ludzie nigdy nie doświadczą i katastrofa w dziedzinie bioinżynierii, która może doprowadzić do eliminacji słabszego gatunku.

Jestem świadom, że jest to jedynie zalążek dyskusji, która toczy się już od dekad, jednak uważam, że jest to dobry wstęp do polemiki na którą szczerze liczę. W moim przypadku, chęć do dyskusji zrodziła się po zobaczeniu w kinie filmu Ex Machina, do którego szczerze Was zachęcam. Wyobraźcie sobie seminarium TEDx, podczas którego naukowiec tłumaczy w jaki sposób działa Sztuczna Inteligencja, jak ją testować, jakie niebezpieczeństwa ze sobą niesie i jaki scenariusz byłby dla człowieka najbardziej satysfakcjonujący. Później tę wiedzę przełóżcie na język filmu, dodajcie dramatyzm sytuacji, konsekwencje czynów i interakcję zafascynowanego człowieka z maszyną, a otrzymacie Ex Machinę. Film, który nie tylko wzbudza podziw i pokazuje, jak daleko można się posunąć w kwestii monitorowania społeczeństwa, przekładania tych danych na preferencje i manipulowanie w ten sposób człowiekiem, ale też przeraża i zmusza do daleko idących refleksji na temat człowieczeństwa, egzystencji i dążenia do perfekcji.

Zaufalibyście maszynie?

W tym miejscu chciałbym Was serdecznie poprosić o udostępnienie tego tekstu swoim znajomym – oczywiście w przypadku, jeśli przypadł Wam do gustu. Im więcej stron dyskusji, tym ciekawsze wnioski możemy wyciągnąć.

Tekst został zainspirowany wydarzeniami z filmu Ex Machina, na który zostaliśmy zaproszeni przez Cinema City.

Grafiki pochodzą z filmów „Ex Machina” oraz „A.I.”.

- 5 Komentarze

- Blog

- 24.03.2015